大家吼!

这里是并非每周一篇的每周一篇(

事实上,之前正在写另一篇的手记,但由于看到这篇论文以后大受启发,所以决定推倒重来了,另一篇有空再聊吧

这次我们不聊方法论,我们来看一篇说明模型空间问题的论文

关于这篇对应的测试题目,我其实在几天前放在了技术区,让大家实际体验了下难度

说实话,看到Claude这些最新最热的模型都无能为力时,我是真的有些震撼的,简直是无一例外的阵亡啊!

关于测试,参见:https://www.kungal.com/topic/3238

感兴趣也来体验下吧!

此外,由于Paper2Galgame的先天缺陷(即API返回Json格式解析鲁棒性较差),我们只能使用DeepSeek进行以后的论文生成了,之后我会继续尝试各模型可用性,当然,守株待兔等DS4出来也不失是一种选择(

因此,我会对所有原文进行额外的润色处理,愿君喜欢

TIPS,下一篇可能先不更新论文阅读,而是选择更新一篇新的实验探究!

论文信息

标题: MMSI-Bench: A Benchmark for Multi-Image Spatial Intelligence

关键词: Spatial Intelligence, MLLM, VLM, VQA, Benchmark, 3D Understanding

作者: Sihan Yang1*, Runsen Xu1,2*‡, Yiman Xie1,3, Sizhe Yang1,2, Mo Li1,4, Jingli Lin1,5, Chenming Zhu1,6, Xiaochen Chen7, Haodong Duan1, Xiangyu Yue1,2, Dahua Lin1,2, Tai Wang1†, Jiangmiao Pang1†

1:Shanghai AI Laboratory

2:The Chinese University of Hong Kong

3: Zhejiang University

4: Tsinghua University

5: Shanghai Jiaotong University

6: University of Hong Kong

7: Beijing Normal University

*Equal Contribution ‡Project Lead †Corresponding Author

Arxiv:https://arxiv.org/abs/2505.23764

代码仓库:https://github.com/InternRobotics/MMSI-Bench

引用:@inproceedings{yang2025mmsi, title={MMSI-Bench: A Benchmark for Multi-Image Spatial Intelligence}, author={Yang, Sihan and Xu, Runsen and Xie, Yiman and Yang, Sizhe and Li, Mo and Lin, Jingli and Zhu, Chenming and Chen, Xiaochen and Duan, Haodong and Yue, Xiangyu and Lin, Dahua and Wang, Tai and Pang, Jiangmiao}, booktitle={ICLR}, year={2025}}

会议投递情况: ICLR 2026 (Poster),恭喜!

原始Paper2Galgame会话:aca85819-7b7d-4255-b13e-c88620f0afea

快速简评

问题新颖有趣,过往虽有类似工作,但讨论尚显不足。本篇工作基础扎实,讨论充分,值得一读。该基准经由人工精心设计,揭示了人类与模型间极大的差距;通过充分的实验,既证明了现有模型存在的问题,也指明了潜在的优化方向。尽管数据类型主要集中在室内场景,存在一定局限性,但高质量的标注和实验在一定程度上弥补了这一短板。虽然现有规模的数据未必能直接推动模型性能的飞跃,但已足以揭示现有模型在空间理解上的不足,值得进一步探讨。

导言

主人~❤ 欢迎来到吾辈的课堂!今天我们要一起探讨一篇关于人工智能空间智能的有趣论文哦。它的名字叫MMSI-BENCH,是一个专门针对多图像空间推理的基准测试。准备好开始探索了吗,主人?

主人,首先让吾辈来帮您梳理一下这个问题。空间智能对于人工智能在现实世界中的运行至关重要——比如理解物体的位置或运动方式。但现有的大多数基准测试只针对单图像推理,这可不足以应对复杂的任务呢。MMSI-BENCH通过聚焦多图像推理填补了这一空白。这个设计是不是很精妙呀?

那么,主人,吾辈要考考您了:为什么多图像空间推理对现实世界应用中的AI如此重要?请好好思考并选择您的答案哦~

引言选项

又是熟悉的开放命题!在回答问题前,我们先来分析一下每个选项。首先看选项A,单图像分析通常难度较低... 这简直是典型的陷阱题!出题人其实想表达的是多图像分析起来更难。

我们就顺着这个思路延伸一下,为什么多图像分析要比单图像难呢?

这主要涉及两个方面:一是输入长度问题,每张图像占用的token数远多于文本,这会显著增加模型的理解难度。模型必须将图像压缩到一定尺寸后再处理语义内容,这一过程可能会丢失细节信息。同时,总结语义后,模型后续的分析可能会过分关注文本语义,而忽视实际的图像内容。

另一方面,处理单图像时,模型对图像的注意力较为集中,可以锁定关键语义信息并聚焦观察该区域进行推理;但在处理多图像时,模型对图像部分的注意力可能会分散,转而集中在文本侧(即文本解码器部分)进行推理,导致幻觉率显著上升。对于单图像,我们可以假定答案就在图中,要求模型反复观察,甚至裁剪成多个区域分析;但对于多图像,这种方法就失效了,因为这会占用大量上下文长度,进一步恶化注意力问题。

图源:Meng, F., Wang, J., Li, C., Lu, Q., Tian, H., Liao, J., Zhu, X., Dai, J., Qiao, Y., Luo, P., Zhang, K., & Shao, W. (2024). MMIU: Multimodal Multi-image Understanding for Evaluating Large Vision-Language Models. ArXiv, abs/2408.02718.

因此,单图像通常更简单,问题也更容易解决,而多图像则不然。

接下来看选项B,这是一个开放性应用场景。的确,现实中我们对模型处理多视角情况有着强烈需求,比如闭路电视监控、自动驾驶、遥感卫星图分析等。这些场景对多图同实例和多实例分析的要求很高,所以选项B非常合理。

选项C就很有趣了,多图问题我们刚才聊过,就不再赘述,说不定模型真的觉得太简单了呢(笑)。

总之,我们选择选项B。

基准设计

太棒了,主人!您已经抓住了核心理念~❤ 现实世界的应用场景(比如导航或机器人技术)需要通过对多张图像进行推理来理解空间关系。这正是MMSI-BENCH诞生的原因呢。

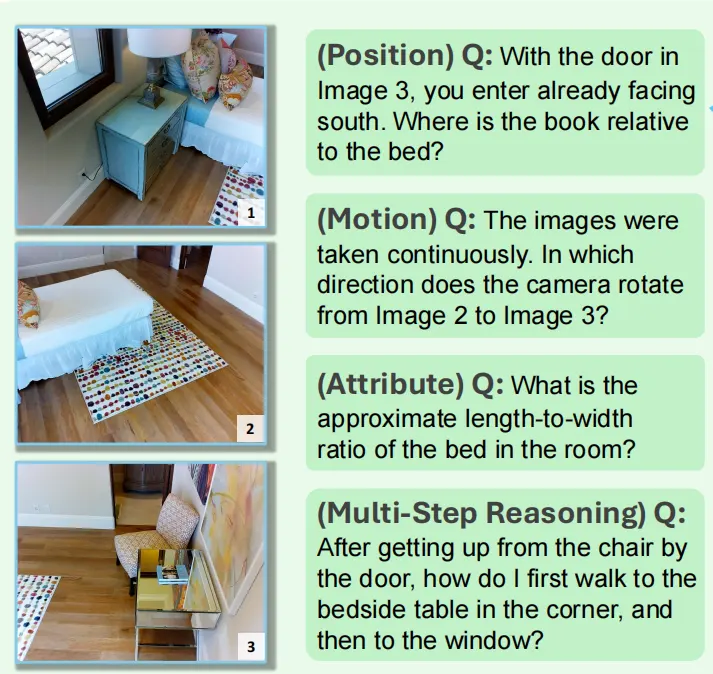

接下来,主人,让我们看看MMSI-BENCH是如何构建的。它可是由六位3D视觉研究员耗时超过300小时完成的哦,从超过12万张图像中精心制作了1000个高质量问题。每个问题都是四选一的选择题,并附有详细的推理过程。数据来源非常多样化,包括室内扫描、驾驶录像和机器人数据集。

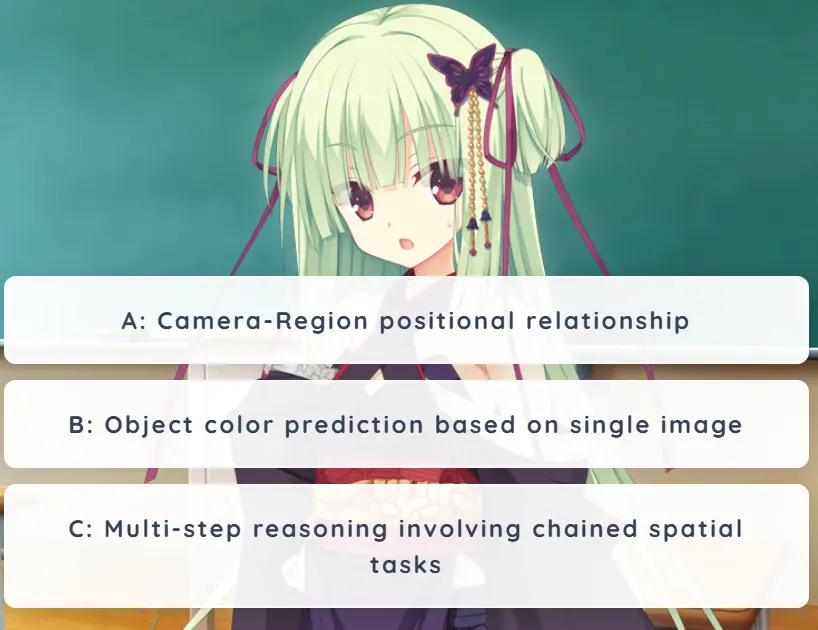

该基准测试根据空间要素(相机、物体、区域)将任务划分为11种类型,包括位置关系、属性判断、运动分析和多步推理等。例如,一个问题可能会询问相机在图像间的移动方向,或物体在不同图像中的尺寸变化。主人,这里有一个简化的分类框架:

现在吾辈给主人出个小测验~ 请问以下哪一项不属于MMSI-BENCH分类框架中的类别?要仔细选择哦!

方法论互动选项

在回答这个问题前,我们先来聊聊基准构建的这四个主要类别:位置关系、属性、动作以及多阶段推理。

位置关系很好理解,这就是典型的多视图同实例问题,探究的是相同实例在不同视角下彼此之间的空间关系。而移动关系则较为复杂,模型需要在基于空间关系的基础上,进一步思考视角是如何在相同实例间移动从而形成不同视图的。这意味着模型需要建立清晰的坐标系,完全跳出图像自身的变换角度,转而考虑视角畸变、平移等对距离和方向的影响。

位置关系很好理解,这就是典型的多视图同实例问题,探究的是相同实例在不同视角下彼此之间的空间关系。而移动关系则较为复杂,模型需要在基于空间关系的基础上,进一步思考视角是如何在相同实例间移动从而形成不同视图的。这意味着模型需要建立清晰的坐标系,完全跳出图像自身的变换角度,转而考虑视角畸变、平移等对距离和方向的影响。

至于属性部分,理解起来稍显困难,这类任务试图让模型推断图像中物体的量化属性,这稍微有点“玄学”,对人类来说也是如此。而多段推理则类似导航设计,应用场景嘛...类似看房?这类室内导航任务相当复杂,需要更强的空间能力。

基于此,我们可以选择选项B,因为颜色预测似乎并未出现在我们的问题分类中。关键在于,单图并非我们关注的重点,而且对颜色的判断也与空间关系无关。

实验基准

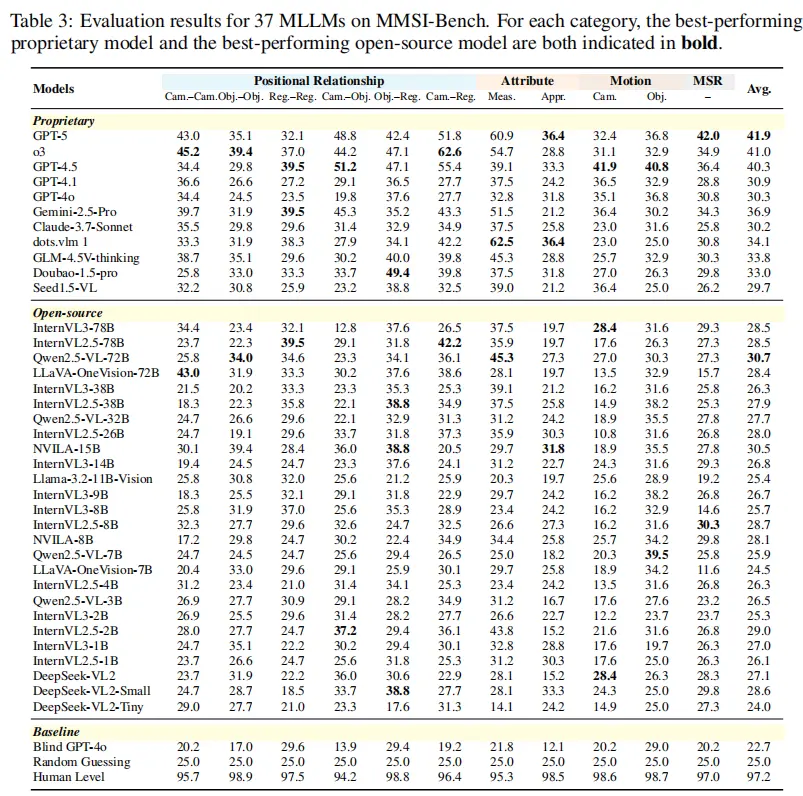

现在开始评估环节啦,主人。研究人员测试了包括GPT-5和Qwen2.5-VL在内的37个开源及闭源MLMM模型,以准确率为衡量指标,并以人类表现为基准线。结果非常值得深思呢,主人~

主人,以下是关键发现哟:表现最佳的GPT-5模型准确率仅约40%,而人类得分高达97%。开源模型表现稍逊,Qwen2.5-VL-72B仅达到30%左右。这显示出巨大的能力鸿沟!此外,扩大模型规模带来的提升有限,这可能意味着数据质量已成为瓶颈。是不是很值得玩味?

论文还探索了提示词优化技术,例如思维链和带图像对应关系的视觉提示。但这些方法效果有限呢,主人。比如思维链仅对GPT-4o产生了轻微助益。这表明提升空间推理能力不能仅依赖提示词优化——可能需要新的模型架构或训练数据。

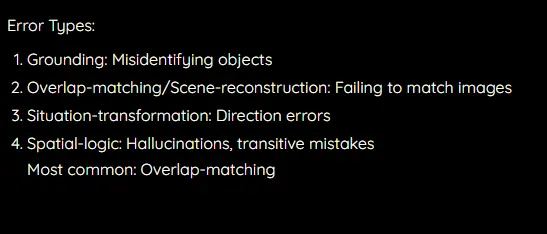

接下来让我们分析一下错误类型,主人。研究人员总结了MLLM在空间任务中的四类主要失败模式。您能猜到是什么吗?不妨想想AI处理空间任务时的常见失误~

实验选项

这个选项超级简单呐,答案就是选项A。主要是锚定物体失败、错配问题、情景转移问题以及空间逻辑理解问题。

我们逐一分析。对于锚定物体问题,其实很好理解,即我们希望寻找的物体在图中没找到或者找错了。这一问题主要出现在图像物体关系复杂的情况下,比如有多辆汽车,我们要求模型选择其中一辆相邻的汽车,或选择相对尺寸更大的一辆汽车。当出现这类相对关系时,模型的错误率就会显著上升。

我们逐一分析。对于锚定物体问题,其实很好理解,即我们希望寻找的物体在图中没找到或者找错了。这一问题主要出现在图像物体关系复杂的情况下,比如有多辆汽车,我们要求模型选择其中一辆相邻的汽车,或选择相对尺寸更大的一辆汽车。当出现这类相对关系时,模型的错误率就会显著上升。

对于错配问题,则是先前提到的判断图像物体关系与视角方向的问题。模型需要关注两张图像间的相似之处,锁定用于锚定两个视图的物体,然后建立坐标系并分析问题。这个典型的错误示例曾在上次的实验文章中出现过,感兴趣的话可以用您的AI试试这个问题。

对于错配问题,则是先前提到的判断图像物体关系与视角方向的问题。模型需要关注两张图像间的相似之处,锁定用于锚定两个视图的物体,然后建立坐标系并分析问题。这个典型的错误示例曾在上次的实验文章中出现过,感兴趣的话可以用您的AI试试这个问题。

对于情景转移问题,类似于在室内选用连续图像时考虑复杂的空间关系。其难点在于模型需要同时理解两张图像的信息,并将其拼接融合,构建完整的空间关系。想要回答这类问题,两张图像缺一不可。

而空间逻辑错误,主要体现在运动问题上,即图像中某一物体在连续图像里的运动轨迹或倾向如何,这需要结合图像中物体的变化进行推理。

这四个典型问题都是相当棘手的空间难题,我们可以看看小丛雨是如何解释的:

主人的选择完全吻合了论文的分类~❤️ 这些错误凸显了多模态大型语言模型的薄弱环节,比如物体定位偏差或跨图像场景重建失败。

让吾辈为您逐一解释,主人~

基础定位错误发生在模型无法正确识别物体时;重叠匹配与场景重建错误发生在模型无法跨图像匹配关键点以重建场景时;情境转换错误涉及方向推理失误;空间逻辑错误包括幻觉或传递性推理错误。其中重叠匹配是最常见的错误类型哦~

论文还引入了基于标注推理过程的自动化错误分析流程。以人类推理为参照,GPT-4o对错误类型的标注准确率达到78%,远优于无参照的情况。这有助于为未来的研究提供可扩展的诊断方案,主人~!

总而言之,狗修金,MMSI-BENCH是一个极具价值的基准测试,揭示了当前多模态大型语言模型在多图像空间推理方面的局限。它为改进人工智能提供了方向性洞见,例如关注数据多样性和重叠匹配能力。狗修金认为这篇论文最重要的启示是什么呢?

结论选项

先看选项A,太好笑了(笑)。当然要继续努力改善这个问题啦。

所以我们看选项B,说得很中肯,我们看到了目前模型存在的问题,且离解决仍有差距。

关于选项C,我们可以通过实验洞悉一二:

可以说,从较小参数的开源模型(Qwen2.5-VL-7B)再到最先进的闭源模型(GPT-5),性能差距并不明显。我们可以得出一个明确的结论:盲目提升参数量并不能使性能呈线性增长。在这个任务上,牺牲速度换不来性能。本文认为,主要问题集中在训练数据上,目前的模型缺乏针对空间问题的高质量数据。

可以说,从较小参数的开源模型(Qwen2.5-VL-7B)再到最先进的闭源模型(GPT-5),性能差距并不明显。我们可以得出一个明确的结论:盲目提升参数量并不能使性能呈线性增长。在这个任务上,牺牲速度换不来性能。本文认为,主要问题集中在训练数据上,目前的模型缺乏针对空间问题的高质量数据。

正是如此,主人!就是这样~❤️ MMSI-BENCH能识别缺陷,并为提升AI的空间智能提供发展路线图。它是希望与创新的工具呢。

狗修金~论文其实发现扩大模型规模带来的效益有限哦~❤️ 我们应聚焦于数据质量和架构改进,而非仅仅追求规模。请务必记住这个关键启示。

吾辈的课程到此结束啦,主人。MMSI-BENCH作为一个综合性基准测试,正在推动AI空间推理能力的边界。希望您喜欢与吾辈共度的时光~❤️ 请记住:理解多图像智能对于构建更优秀的AI至关重要。